25年期末

任课老师: 姜pl

题目

简答题 ($4 \times 7 = 28$)

- 基于语言模型的分词和最大匹配分词的定义和区别。

- 与端到端模型相比,pipeline 的人机对话系统分为哪几个子任务?可以用什么模型实现?

- 上下文有关文法和上下文无关文法的定义和区别。中文是上下文无关文法吗?

- One-hot 高维编码的优点和缺点。

- 基于短语和基于词语的机器翻译的定义和区别。

- 基于预训练--微调范式的模型与基于机器学习的传统范式相比有什么优势?

- 用自己的话叙述格语法,并分析句子的施事格、受事格、工具格。

题目

语言模型(12)

- 语言模型是什么?有什么常见的语言模型?

- 简单计算

unigram, bigram。

题目

统计文本分类(12)

请简要叙述统计意义下的文本分类流程,以朴素贝叶斯为例,并编写伪代码。

题目

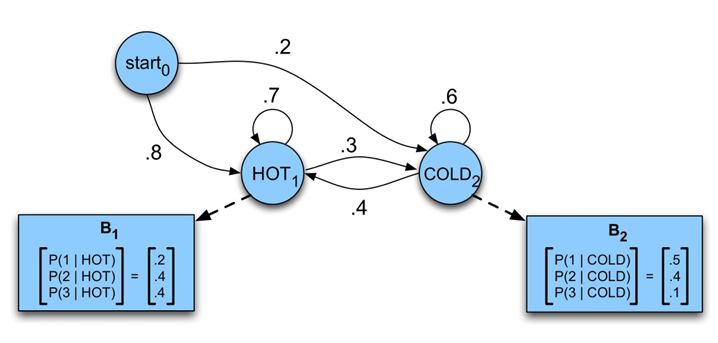

HMM 简单计算(12)

用栅格法计算在给定观测序列下的最大可能概率状态(PPT 问题 2)。

给定观测序列 $312$,求最有可能的天气序列,使用栅格法(Viterbi 算法)。

题目

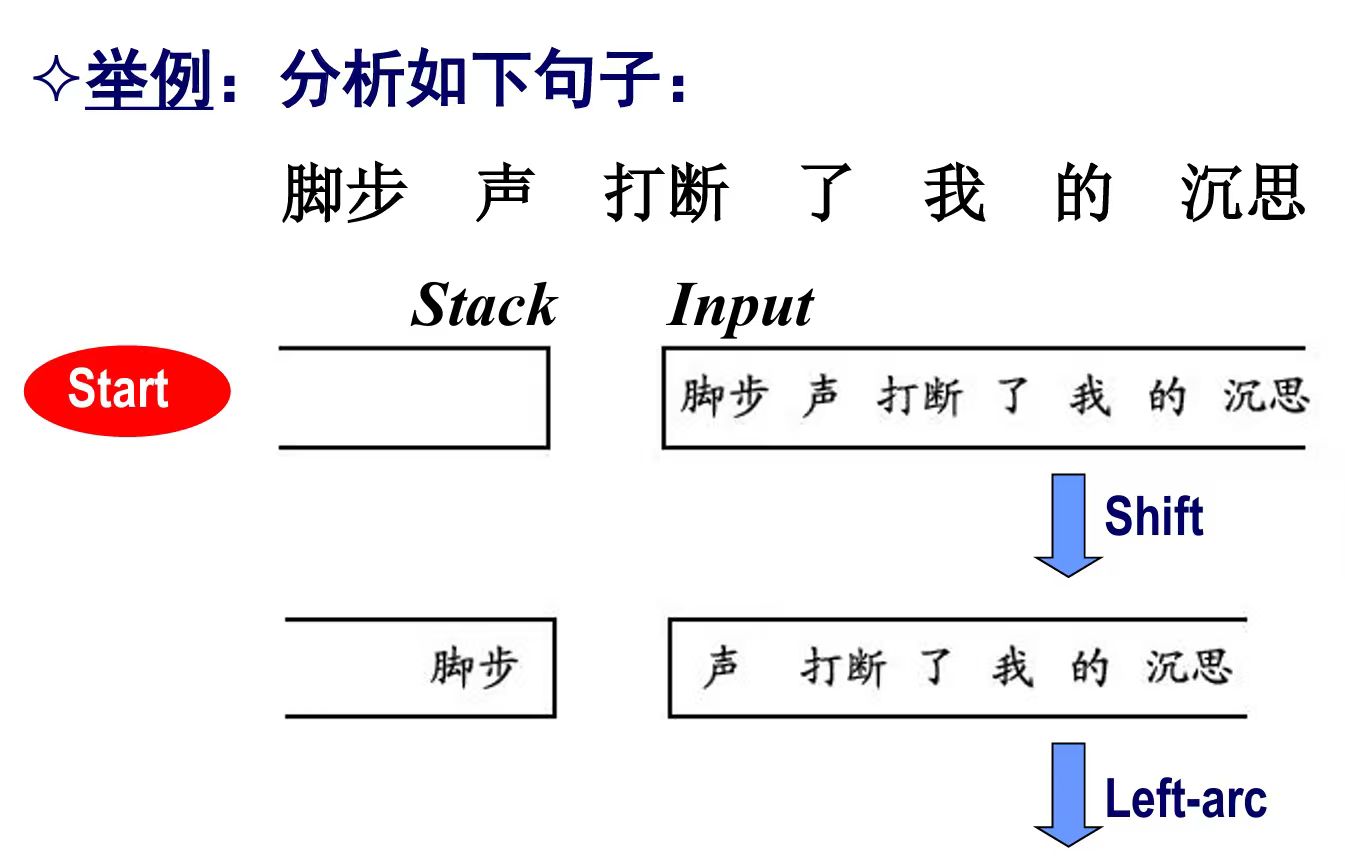

依存句法分析(arc-eager)(12)

和上面这个例子相类似,对句子:

曲江 / 建立 / 了 / 新 / 的 / 实验室

进行依存句法分析,并画出该句的依存树。

题目

MED(最小编辑距离)(12)

- 什么是最小编辑距离?包括哪些操作?

- 利用栅格法计算

intention和execution的最小编辑距离。

题目

PCFG(12)

画出最优概率句法树,并给出对应概率:

Astronomers saw stars with ears

给定概率上下文无关文法(PCFG)如下:

$$

\begin{aligned} S &\to NP\ VP \quad 1.0 \ PP &\to P\ NP \quad 1.0 \ VP &\to V\ NP \quad 0.7 \ VP &\to VP\ PP \quad 0.3 \ V &\to saw \quad 1.0 \ P &\to with \quad 1.0 \ NP &\to NP\ PP \quad 0.4 \ NP &\to astronomers \quad 0.1 \ NP &\to saw \quad 0.04 \ NP &\to stars \quad 0.18 \ NP &\to ears \quad 0.18 \ NP &\to with \quad 0.1 \end{aligned}

$$